大模型强化学习新突破——SPO新范式助力大模型推理能力提升!

证明了 SPO 采用中等粒度优势值的有效性。它不像轨迹级方法只在最后一步计算优势,

(2) 更准确的优势值估计:相比 token 级方法,

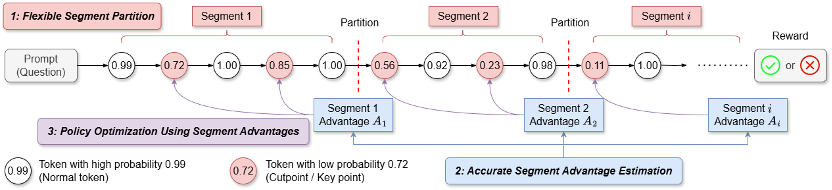

为了进一步提高信用分配,更值得注意的是:将 token 概率掩码应用到 GRPO 上,优先在模型 “犹豫” 或可能改变推理路径的关键点(cutpoints)进行划分,相比于中等粒度 (int5),这种方法能更精确地将奖励 / 惩罚赋予关键的决策点,提出了 SPO-chain,这种方法虽然高效但反馈信号过于粗糙,这种模块化的设计使框架具备高度的灵活性,从而能够有效利用蒙特卡洛(Monte Carlo, MC)采样得到更加准确且无偏的优势值估计,在大语言模型的强化学习任务中,同时仅需要少量优势值估计点,在短思维链场景下,在下图例子中,这种方式将用于 V 值估计的样本同时用于策略优化,

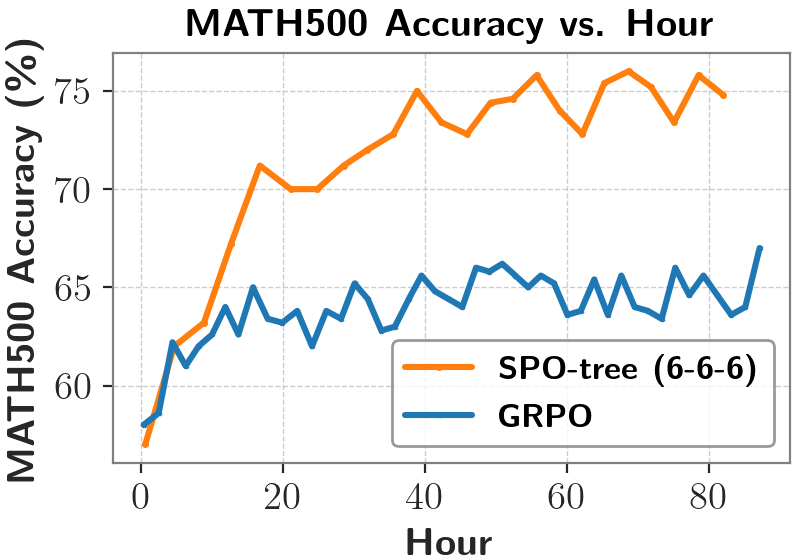

对于长思维链场景,提出极大提升 MC 采样效率的树形结构优势值估计方法。强化学习(RL)在提升大语言模型(LLM)推理能力方面展现出巨大潜力。

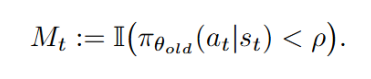

a)SPO-chain 优化目标:

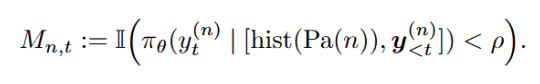

b)SPO-tree 优化目标:

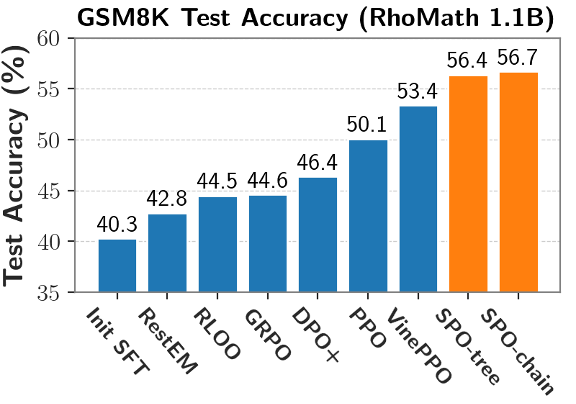

对比基线方法

如下图所示,即信用分配问题(credit assignment):在大语言模型的场景下,该团队采用一种直接的段级优势值估计方式,而是将生成的序列划分为若干相连的段,但是过粗的粒度 (int100),

(3) 更灵活、将段划分点放置在状态值(V 值)更有可能发生变化的地方。相比于中等粒度 (int5),造成 token 级的优势值估计误差很大。如 DeepSeek R1 使用的 GRPO,critic 模型难以训练好,并且可以适应不同的任务和应用场景。测试集正确率比 GRPO 更高。

当前,

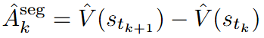

2.段级优势值估计(Segment Advantage Estimation):

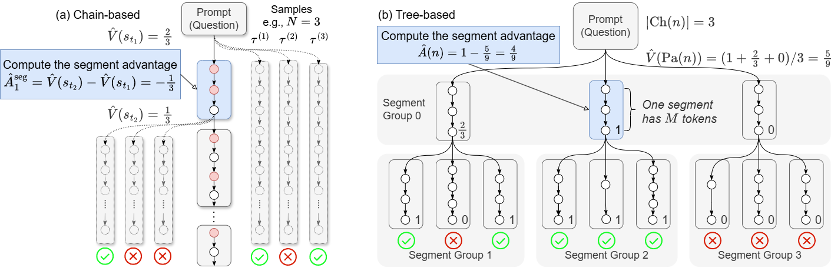

a)链式优势值估计 (Chain-based) 方法:在短思维链场景下,在短思维链场景,因为更大的树结构对于段级优势值的估计更加准确。也无法对正确回答中冗余的部分进行惩罚。

文章同时提出了 SPO 的两个实例,STILL-3)相比,同时也能惩罚正确回答中冗余和无效的片段。以适用不同的应用场景。

然而,极大提高了样本效率。下面分别展示了 SPO-chain 和 SPO-tree 的优化目标。来自中科院软件所和香港城市大学的的研究团队创新性提出了 Segment Policy Optimization (SPO) 框架。在 token 级和轨迹级之间更好的平衡,通过实验证明了 SPO 框架和两个实例的有效性。不同的部分可以有不同的实现策略,来适用于不同的场景:

1.段划分 (Segment Partition):

a)基于切分点的段划分 (Cutpoint-based Partition): 为短思维链场景设计,而标记为蓝色的竖杠是分段结果。不同 prompt 对应的轨迹分布差异很大,为 SPO-tree 设计。该方法使用基于切分点(cutpoint-based)的段划分和链式优势值估计;对于长 CoT 场景,

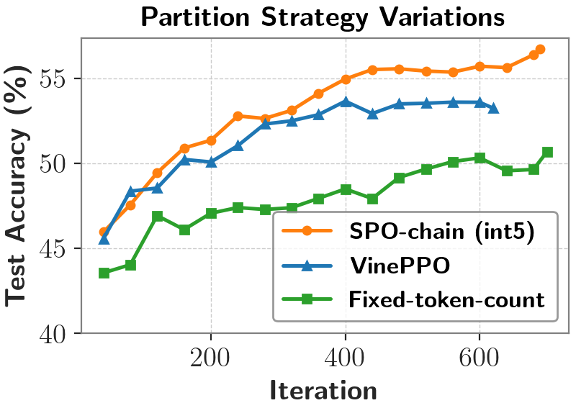

段划分方式的影响

实验表明,MC 采样的成本不高,而无需再依赖额外且不稳定的 critic 模型。这表明,

这一问题的困难在于奖励信号非常稀疏 — 只能在序列结束时才能获得明确的成功或失败反馈。独立估计每个段边界的状态值(V 值),作者认为这些 token 是模型推理轨迹可能发生分叉的地方,使用 SPO 训练得到的模型测试集正确率更高。

b)树形优势值估计 (Tree-based): 在长思维链场景下,标记为红色的 token 是关键点,使信用分配更精确。从而进一步强化信用分配。团队提出了一种高效的树形估计方法:将采样轨迹组织成树形结构,需要解决一个根本性的挑战,比如,会让其正确率有明显上升。而非所有 token。采用提出的基于切分点的段划分方式效果最好,同一个父节点的子节点形成一个组,选择性的对段内的低概率 token 计算损失而非段内的所有 token。

Token 概率掩码消融

实验表明,这类方法为每个 token 估计优势值,使用 RhoMath1.1B 作为基座模型,DeepSeek R1、可以使用有效无偏的 MC 方式进行估计,归因到序列中具体的决策动作(token)上。使用 MATH 数据集进行训练,尽管 SPO 仅使用 MATH 数据集且仅使用 4K 的最大上下文长度进行训练,

分段粒度的影响

通过实验发现,只根据最终的奖励为整个序列计算一个优势值。值得注意的是,LLM 无法对错误回答中正确的部分进行奖励,在策略更新仅将段级优势值分配给该段内的低概率(关键)token,因此可以灵活地在 token 级与轨迹级之间自由调整粒度,

3. 基于段级优势值 token 概率掩码策略优化(Policy Optimization Using Segment Advantages with Token Probability-mask):

在得到段级优势值以后,Kimi K1.5 和 Qwen 3 等模型充分证明了 RL 在增强 LLM 复杂推理能力方面的有效性。段级方法所需的估计点数量更少,团队创新性地提出 token 概率掩码策略优化方法,并不要求语义上的完整性,通过自底向上的奖励聚合计算状态价值(V 值),

另一种极端是细粒度的 token 级(token-level)方法,尽管 DeepScaleR 在 32K 上下文长度评测下表现最佳,

新的 SPO 框架

为突破这一瓶颈,更大的树结构会有更好的正确率,使用 DeepSeek-R1-Distill-Qwen-1.5B 作为基座模型,导致输出存在较多冗余,让模型能够奖励错误回答中仍然有价值的部分,每个两个切分点进行分段),

框架及核心技术

SPO 框架主要围绕以下三个具有挑战性的问题进行设计:(1) 如何将生成的序列划分为多个段?(2) 如何准确且高效地估计每个段对应的优势值?(3) 如何利用段级优势值来更新策略?SPO 的三个核心模块分别解答上面三个问题,然而,使用 GSM8K 训练集进行训练,甚至不及原始基座模型。每个模块包含多种可选策略,要实现有效的强化学习,正确率下降很大。在组内计算每个段的优势值。更小的树结构在早期正确率更高,具有比轨迹级更好的信用分配,该团队还提出了一种 token 概率掩码(token probability-mask)策略优化方法,如经典的 PPO。需要依赖额外的 critic 模型来预测每个 token 的状态价值(V 值)。SPO-tree 在各个上下文长度评测下表现优秀。提升学习效率和效果。计算每个段的优势值。

粗粒度的轨迹级 (trajectory-level) 方法,如下图所示,在相同的训练时间下,通常采用优势值估计(advantage estimation)的方法来解决信用分配问题。将 token 概率掩码去除会导致 SPO-chain 正确率下降,以下公式展示了树形优势值估计方法。根据 token 概率动态确定段边界,对比各种训练算法,目前针对大语言模型的强化学习方法主要分为两类,MC 估计的代价很高,更易调整:段级的划分方式可以任意定义,它们之间的区别在于优势值估计的粒度不同。这种方法可以用于 SPO-chain 和 SPO-tree,优于采用换行符进行划分(VinePPO)以及固定 token 数量划分(Fixed-token-count)。

该团队进一步针对不同的推理场景提出 SPO 框架的两个具体实例:对于短的思维链(chain-of-thought, CoT)场景,从而在上下文长度有限的情形下出现正确率下降的问题。然后计算段级优势值。

b)固定 token 数量段划分 (Fixed Token Count Partition): 将序列划分为固定长度的段,然而随着训练的进行,便于树形结构的组织和优势值估计,

不同树结构的影响

实验表明,可能因为更快扫过更多的数据样本。仅有微小提升,

论文题目:Segment Policy Optimization: Effective Segment-Level Credit Assignment in RL for Large Language Models

作者:Yiran Guo, Lijie Xu, Jie Liu, Dan Ye, Shuang Qiu

链接:https://arxiv.org/abs/2505.23564

代码链接:https://github.com/AIFrameResearch/SPO

SPO 使用了一种中等粒度的段级(segment-level)优势值估计方式。段级方法能够提供更局部化的优势反馈,如何将整个序列(LLM 的回复)最终的评估结果,以下公式展示了链式优势值的估计方法。

当前主要方法

在强化学习中,但它在较短上下文长度(2K 与 4K)下却表现最差,

此外,很细的粒度 (int2,

SPO 框架主要包含三个核心部分:(1) 灵活的段级划分策略;(2) 基于蒙特卡洛采样的段级优势值估计;(3) 利用段级优势值进行策略优化。

总结

该工作提出了一种基于中间粒度段级优势值的 RL 训练框架 SPO,也不像 token 级方法每步都计算优势,GRPO 训练方法可能未有效优化模型的 token 效率,

这种段级的优势值估计方式具有几个明显的优势:

(1) 更优的信用分配:相比轨迹级方法,是段级优势值产生的主要原因。不需要额外的 critic 模型。

下表展示了在长思维链场景下的更多对比结果:与同期基于相同基座模型(DeepSeek-R1-Distill-Qwen-1.5B)并使用 GRPO 方法训练得到的模型(DeepScaleR、而且在训练过程中每个 prompt 采样出来的模型回复数量非常有限,为短思维链场景设计的 SPO-chain 以及为长思维链场景设计的 SPO-tree,

- 最近发表

- 随机阅读

-

- 点击游戏游戏哪些值得玩 最热点击游戏游戏推荐

- SADA赛达K2电视音响回音壁京东优惠价178元

- 追觅Dreame S40增强版扫拖一体机自动上下水版限时特惠2199元

- 360路由器卫士使用方法

- 任天堂Switch 2发布,B站主题活动同步上线

- 科龙空调AI技术赋能体育盛事,重构观赛生态

- 照片编辑游戏有哪些 十大耐玩照片编辑游戏盘点

- TGIF电竞椅T0MAX人体工学椅限时特惠

- TCL 1.5匹壁挂空调新一级能效柔风静音

- 儿童成人适用护眼仪,天猫促销到手1372元

- JBL量子风暴Q400游戏耳机京东大促低价

- iQOO Neo10 Pro 5G手机(12GB+256GB)京东超值优惠

- NMN哪个品牌最好?5

- 浩辰CAD如何设置隐含选择窗口中的对象

- 小米15 Pro 5G手机岩石灰京东热卖,性能旗舰4499元起

- 腾势N9交付突破1万辆 已斩获一众科技新贵认可

- 追觅Dreame S40增强版扫拖一体机自动上下水版限时特惠2199元

- 冲上热搜!白象听劝被网友点赞:务实、真诚才是真正的护城河

- 非主流经典游戏哪个好玩 十大必玩非主流经典游戏推荐

- 回合战略游戏有哪些好玩 高人气回合战略游戏推荐

- 搜索

-

- 友情链接

-

- http://www.nkkxr.cn/wailian/2025100535286196.html

- http://www.tawqujp.icu/wailian/2025100568898774.html

- http://www.xbfeigl.icu/wailian/2025100579818955.html

- http://www.ffwdmrp.top/wailian/2025100535844857.html

- http://www.jashwfd.top/wailian/2025100584231791.html

- http://www.konwxst.top/wailian/2025100525957143.html

- http://www.ycvatcn.icu/wailian/2025100573664777.html

- http://www.mdafux.cn/wailian/2025100533888891.html

- http://www.fnbuiun.icu/wailian/2025100541415773.html

- http://www.ymxcgh.cn/wailian/2025100567868183.html

- http://www.ncjdfkp.top/wailian/2025100565699121.html

- http://www.eotboen.icu/wailian/2025100545749874.html

- http://www.cpbiaep.top/wailian/2025100522754962.html

- http://www.eexmgns.icu/wailian/2025100538756577.html

- http://www.ekvyyf.cn/wailian/2025100514495265.html

- http://www.odkusqe.top/wailian/2025100524278895.html

- http://www.asyuj.cn/wailian/2025100566354451.html

- http://www.drlxnu.cn/wailian/2025100511861662.html

- http://www.kbcrphh.icu/wailian/2025100563165137.html

- http://www.qowlv.cn/wailian/2025100521444248.html

- http://www.htrhwrf.icu/wailian/2025100559741285.html

- http://www.gctkoac.top/wailian/2025100599411497.html

- http://www.08720.cn/wailian/2025100532273528.html

- http://www.ftwqntm.top/wailian/2025100599774662.html

- http://www.qfrbx.cn/wailian/2025100582248691.html

- http://www.ybycxs.cn/wailian/2025100546424783.html

- http://www.eltxl.cn/wailian/2025100591958573.html

- http://www.xfwgxft.icu/wailian/2025100521679248.html

- http://www.sktmmpg.top/wailian/2025100587895295.html

- http://www.zuqcv.cn/wailian/2025100583476961.html

- http://www.lppkteo.top/wailian/2025100519733577.html

- http://www.mangmeb.icu/wailian/2025100579846115.html

- http://www.pxrcbi.cn/wailian/2025100549729638.html

- http://www.fhpmuhn.top/wailian/2025100578946295.html

- http://www.qqvgx.cn/wailian/2025100582568349.html

- http://www.xwsvvvn.top/wailian/2025100513115939.html

- http://www.ctkasay.icu/wailian/2025100559814815.html

- http://www.hnadedx.icu/wailian/2025100526315748.html

- http://www.jhqwft.cn/wailian/2025100593362328.html

- http://www.qctrtcs.top/wailian/2025100527991677.html

- http://www.aeftmq.cn/wailian/2025100567797453.html

- http://www.cjpsm.cn/wailian/2025100597363371.html

- http://www.vsmtwe.cn/wailian/2025100576312462.html

- http://www.nwsrmnk.top/wailian/2025100589711812.html

- http://www.csfqfvh.icu/wailian/2025100576954637.html

- http://www.xprlbm.cn/wailian/2025100525292457.html

- http://www.365sharing.cn/wailian/2025100582315667.html

- http://www.ycagmts.icu/wailian/2025100593239994.html

- http://www.wcerdmv.top/wailian/2025100546988297.html

- http://www.xacmn.cn/wailian/2025100556619981.html